英国国家网络安全中心(NCSC)警告称,人工智能工具可能会助长勒索软件威胁的升级,将对网络安全产生一定的不利影响。

该机构称,网络犯罪分子现在已经利用人工智能进行一些恶意攻击行为,这种现象极可能在未来两年内进一步恶化,这增加了网络攻击的数量和严重程度。

国家安全委员会认为,人工智能能够帮助那些缺乏经验的威胁行为者、以及雇佣黑客和低技能的黑客节省时间,进行更有效、更有针对性的攻击。

大多数现有的大型学习模型(LLM)平台,如 ChatGPT 和 Bing Chat,都有防止平台创建恶意内容的保护措施。

但NCSC 称目前网络犯罪分子正在制作和营销专门的生成式人工智能服务,以辅助他们进行犯罪活动。比如 WormGPT,这是一种付费的 LLM 服务,允许威胁行为者生成恶意内容,包括恶意软件和网络钓鱼诱饵。这表明,该技术已经摆脱了受控安全框架的限制,并能够在更广泛的犯罪生态系统中使用。

国家安全委员会在另一份威胁评估报告中提到:目前包括勒索软件行为者在内的不少威胁行为者都已经开始使用人工智能来提高网络行动各方面的效率和效果,如侦察、网络钓鱼和编码。可以确信这样的趋势将持续到 2025 年以后。

报告指出,人工智能在网络风险领域的作用预计将是演变性的,它将增强现有的威胁,而不是变革性的。

国家计算机安全委员会的评估要点如下:

- 未来两年,人工智能可能会加剧网络攻击,特别是通过当前战术的演变

- 目前,包括国家和非国家实体在内的熟练和不太熟练的网络威胁行为者都在利用人工智能

- 人工智能加强了侦察和社会工程学,使其更加有效和难以察觉

- 在 2025 年之前,人工智能在网络行动中的复杂应用将主要局限于能够获得高质量数据、专业知识和资源的行为体

- 通过更快、更有效的数据分析和人工智能模型训练,人工智能将使针对英国的网络攻击更具影响力

- 人工智能降低了网络犯罪新手的准入门槛,加剧了全球勒索软件威胁

- 到 2025 年,人工智能能力的商品化可能会扩大网络犯罪分子和国家行为者获取先进工具的渠道。

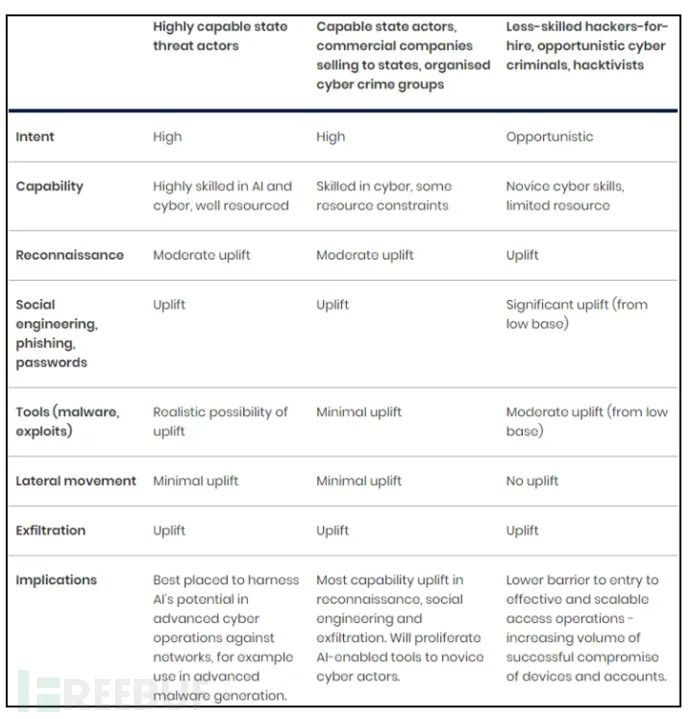

下表总结了人工智能对三种技能水平的特定威胁领域的影响:

NCSC 认为人工智能能够帮助复杂的 APT帮助更便捷、更快速地生成躲避性定制恶意软件。

人工智能有可能生成能够躲避当前安全过滤器检测的恶意软件,但前提是必须使用高质量的漏洞利用数据对其进行训练。还有一种可能性是,能力强大的国家已拥有足够大的恶意软件库,可以为此有效地训练人工智能模型。

分析报告指出:人工智能可能会通过提高现有技术的效率,协助恶意软件和漏洞开发、漏洞研究和横向移动。同时,中级黑客将在侦察、社会工程学和数据提取方面获得优势,而技能较低的威胁行为者将看到全面的提升,但横向移动除外,因为它仍然具有挑战性。

NCSC 认为,生成式人工智能和大型语言模型的出现,让人们在识别网络钓鱼、欺骗和社交工程企图等方面面临巨大挑战。

暂无评论

要发表评论,您必须先 登录